Erros Comuns a Evitar ao Usar Vozes de Inteligência Artificial

Escrito por

Sam Kearney

Publicado em

23 de agosto de 2024

Introdução

Incorporar vocais de IA na sua música é uma ferramenta empolgante e inovadora para músicos e produtores, graças aos avanços em inteligência artificial. Como qualquer nova tecnologia, requer alguns ajustes para obter os melhores resultados. No Kits, processamos conjuntos de dados para criar configurações ideais para o treinamento preciso e realista de modelos de vocais de IA. Com o tempo, observei erros comuns que podem prejudicar o desempenho de vocais gerados por IA. Neste artigo, destacarei esses erros e oferecerei dicas de como otimizar seus modelos vocais de IA.

Nível e Dinâmica

A voz humana é única, muito parecida com uma impressão digital, com seu próprio timbre e nuances emocionais. O canto é tipicamente uma forma intensificada de expressão emocional e pode variar naturalmente em volume. Ao gravar vocais, essas variações são frequentemente gerenciadas usando técnicas de microfone e compressores. Cantores de sessão experientes podem "auto-comprimir" ajustando sua distância do microfone durante seções altas. No entanto, mesmo com essa técnica, compressão adicional é geralmente necessária para manter uma mixagem equilibrada.

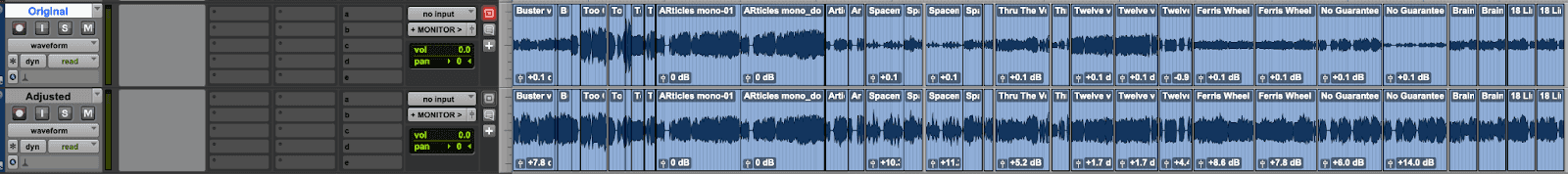

Assim como a compressão natural beneficia as músicas, ela também melhora o processo de treinamento para modelos vocais de IA. No Kits AI, descobrimos que faixas vocais com um alcance dinâmico controlado produzem melhores resultados quando se trata de clonagem vocal, especialmente ao usar software avançado para processamento. Minha técnica pessoal para preparar um vocal para treinamento é importar a faixa para minha DAW e usar ganho de clipe para nivelar algumas das seções mais extremas antes de aplicar qualquer compressão adicional. Isso garante que o compressor trabalhe eficientemente sem introduzir sons não naturais.

Na imagem abaixo, a faixa superior mostra o conjunto de dados original, enquanto a faixa inferior ilustra meus ajustes de nivelamento:

Usando essa abordagem, apenas uma leve compressão é necessária. Recomendo não mais do que 3-5 dB de redução de ganho.

Para resultados ótimos, mire em um nível de volume médio de -12 dB com picos não superiores a -6 dB. Isso cria uma ótima base para aprendizado de máquina e cria modelos de voz de IA mais realistas.

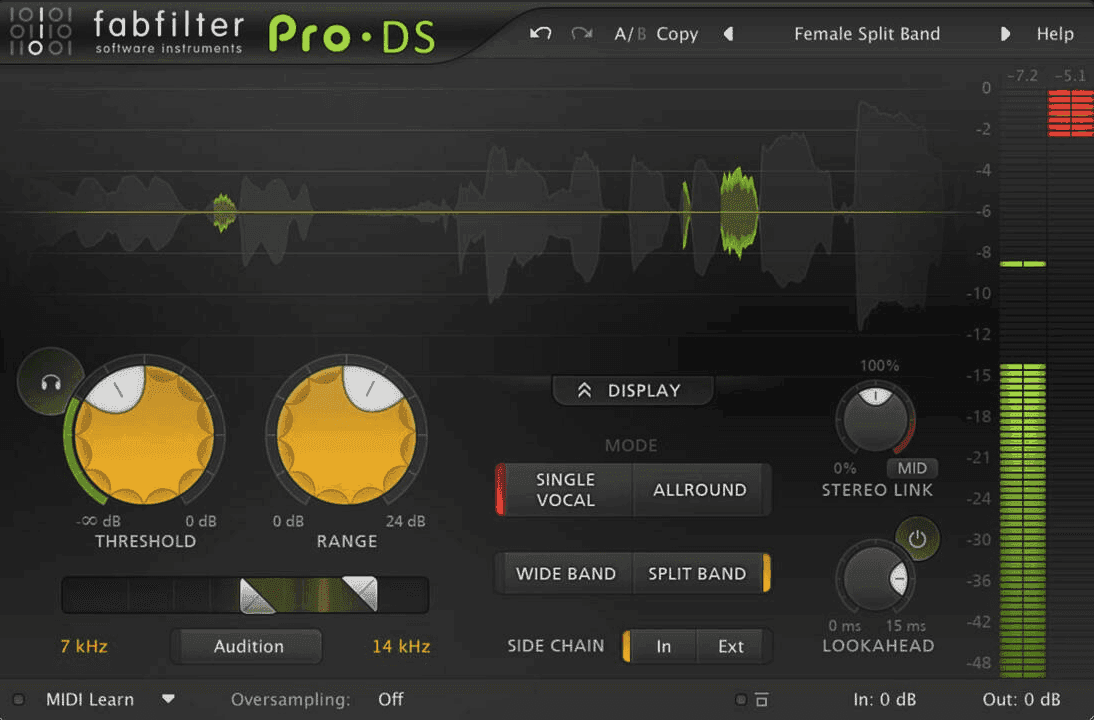

De-ess para Reduzir Sibilância Aguda

Sibilância aguda, causada por consoantes como “s”, “t” e “z”, pode ser distrativa e desagradável em gravações vocais. Um de-esser, como o FabFilter’s Pro-DS, é essencial para controlar esses sons brilhantes. Isso garante que seu modelo de voz de IA não seja treinado para replicar esses elementos agressivos, resultando em uma saída mais suave e profissional.

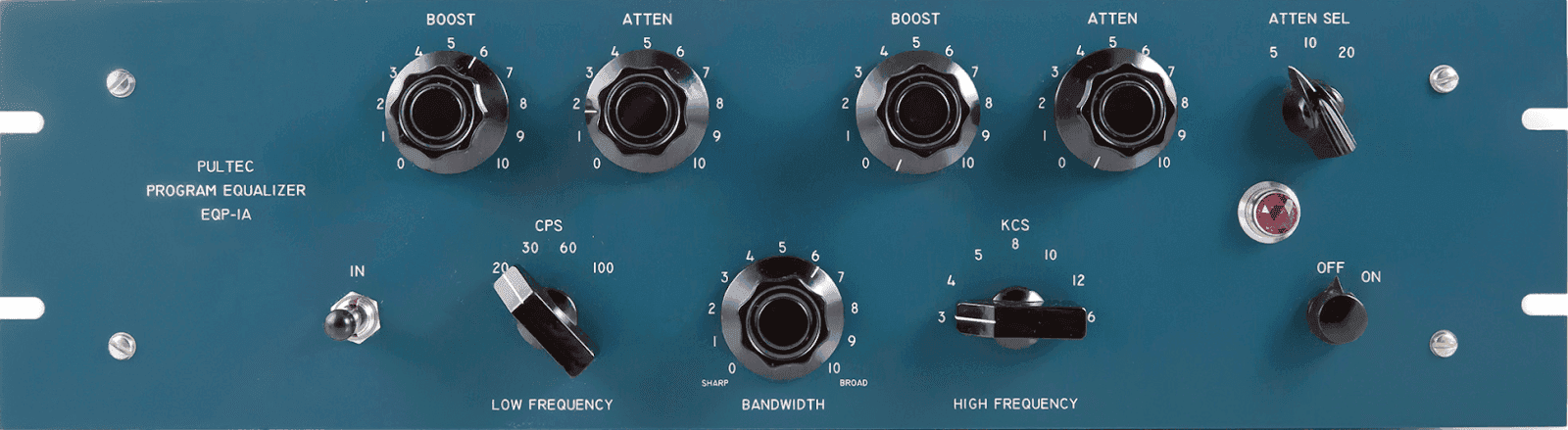

EQ: Equilibrando o Espectro

A equalização (EQ) desempenha um papel crucial na modelagem do som de uma gravação vocal. Enquanto as configurações específicas de EQ podem variar dependendo do conteúdo musical, um EQ bem equilibrado pode melhorar significativamente a qualidade do seu clone de voz de IA e fornecer um ótimo ponto de partida para qualquer contexto e gênero no qual seu modelo de voz de IA existirá.

Comece com um filtro passa-alta para remover qualquer frequência baixa desnecessária que não contribua para o tom vocal. No entanto, tenha cuidado ao passar de 100 Hz, pois isso pode eliminar elementos importantes do timbre vocal.

Na outra extremidade do espectro, esteja atento a frequências agudas agressivas que podem ser introduzidas por muitos microfones mais acessíveis. Nem todos têm um Neumann vintage para cantar (inclusive eu). Um filtro passa-baixa pode ajudar a domar essas frequências, geralmente em torno de 20 kHz e acima.

Usando um EQ como o Pultec EQP-1A, conhecido por seu caráter suave e quente, é uma ótima escolha para limpar o ruído de fundo e suavizar os agudos.

Correção de Pitch: Quando e Como Usá-la

Ferramentas de correção de pitch são frequentemente usadas como um efeito na produção musical moderna. No entanto, ao treinar um modelo de voz de IA, recomendo manter os vocais naturais e aplicar a correção de pitch após o vocal já ter sido clonado. Essa abordagem mantém o realismo do seu modelo de IA e oferece flexibilidade para projetos futuros que possam exigir um som mais natural.

Variedade Vocal: Expanda Seu Material de Fonte

Um dos erros mais comuns no treinamento vocal de IA é a falta de variedade no conjunto de dados vocais. Modelos de aprendizado de máquina só podem treinar a partir do material fornecido, então um conjunto de dados limitado resulta em um modelo vocal limitado. Para elaborar, recebi submissões que incluem cantores interpretando uma música várias vezes. Embora possam soar ótimos naquela única música, sei que são capazes de alcançar notas mais altas e baixas, exibir inflexões vocais mais intensas e suaves, tudo o que não será incluído em seu modelo vocal porque o aprendizado de máquina não tem acesso a essas informações adicionais. Como resultado, isso fornecerá um caso de uso muito limitado para um modelo de voz de IA.

Para criar vozes de IA versáteis, inclua uma ampla gama de performances vocais no seu material de treinamento. Isso deve cobrir diferentes tons, expressões emocionais e técnicas vocais, incluindo vozes de peito e falsete, para imitar a versatilidade de um artista real. Embora o requisito mínimo seja de 15 minutos de áudio, recomendo usar os 30 minutos completos para capturar todo o alcance das habilidades do vocalista.

Remova o Espaço Vazio

Submissões vocais são frequentemente versões a capela de músicas em sua totalidade. Como o processo de aprendizado de máquina se importa apenas em analisar uma performance vocal, longos espaços vazios, que podem ser seções instrumentais de uma música completa, são desnecessários e ocupam um tempo valioso no conjunto de dados. Para otimizar seu modelo de voz de IA, remova quaisquer seções não vocais e assegure-se de que o áudio seja contínuo, como mostrado no meu exemplo inicial acima. Usar essa abordagem maximizará os dados de treinamento e ajudará seu modelo a reter o máximo de realismo possível.

Exporte Seu Áudio Como Mono Verdadeiro

Finalmente, sempre exporte seus stems vocais como faixas mono verdadeiras. Enviar faixas estéreo, mesmo que a gravação tenha sido em mono, dobra os dados percebidos e reduz a quantidade de material utilizável para treinamento. Para obter os melhores resultados de clonagem vocal, maximize a quantidade de material que seu modelo pode ser treinado exportando sua faixa vocal em mono antes de enviar para Kits.AI.

Conclusão

Ao seguir essas dicas, você pode evitar erros comuns de vocais de IA e começar a desbloquear todo o potencial dessa poderosa ferramenta. Lembre-se, IA não é uma ferramenta criativa, é uma ferramenta do criador. Como todas as novas ferramentas e tecnologias emergentes, existe uma curva de aprendizado, mas com a abordagem correta, incorporar vocais de IA na sua música pode abrir novas possibilidades que antes eram inimagináveis.

-SK

Sam Kearney é produtor, compositor e designer de som com sede em Evergreen, CO.

Comece, grátis.

Otimize seu fluxo de produção vocal com ferramentas de áudio em qualidade de estúdio baseadas em IA.